AKTUELLE NEWS AUS DER KI-WELT

KI IM KRIEG: WIE KÜNSTLICHE INTELLIGENZ DAS SCHLACHTFELD VERÄNDERT

Photo by Tech. Sgt. Cory Payne | USAF | www.af.mil/News/Photos/igphoto/2002504827/

Killerroboter oder KI-Helfer: Über Künstliche Intelligenz in der Kriegsführung und wie sie in den Krieg verändert.

Es gibt vier wesentliche Anwendungsbereiche für KI-Technologie im Militär: Logistik, Aufklärung, Cyberraum und Kriegsführung.

In den ersten drei Bereichen sind moderne KI-Anwendungen bereits im Einsatz oder werden getestet. KI hilft, Logistikketten zu optimieren, notwendige Wartungen vorherzusagen, Schwachstellen in Software zu finden und riesige Datenmengen zu verwertbaren Informationen zusammenzuführen.

Künstliche Intelligenz hat daher schon jetzt eine Auswirkung auf militärische Operationen. Doch der Kampf selbst wird noch immer primär von Menschen ausgeführt.

Die dritte Revolution in der Kriegsführung

Ein Vorbote KI-gestützter Kriegsführung ist die wachsende Anzahl ferngesteuerter Drohnen in Konfliktgebieten überall auf der Welt: Zwischen 2009 und 2017 nahm die Zahl amerikanischer Soldaten im Kampfeinsatz um 90 Prozent ab und die Zahl der US-Drohnenschläge stieg um das Zehnfache. Heute fliegen amerikanische, russische, israelische, chinesische, iranische und türkische Drohnen Angriffe im Nahen Osten, auf dem afrikanischen Kontinent, in Südostasien und in Europa.

Viele Drohnen verfügen bereits über teil-autonome Fähigkeiten. Völlig autonome Drohnen, die ihre Ziele selbstständig identifizieren und angreifen, sind eine realistische Möglichkeit, und einem UN-Bericht zufolge könnten sie bereits eingesetzt worden sein.

Die US Air Force testet die für die Aufklärung bewährte MQ-9 Reaper Drohne für den Luftkampf und die Raketenabwehr mit einer Luft-Luft-Rakete. | Bild: USAF

Solche Systeme sind ein Beispiel für tödliche autonome Waffensysteme („Lethal Autonomous Weapon Systems“ – LAWS). Es gibt internationale Bemühungen, sie stark zu regulieren oder komplett zu verbieten. Da sie allerdings einen Krieg entscheiden könnten, sträuben sich besonders die großen Militärmächte gegen ein Verbot.

Denn autonome Waffen gelten als die dritte Revolution in der Kriegsführung nach der Erfindung der Atombombe und des Schießpulvers. Sie haben die gleiche Kapazität, das Mächtegleichgewicht zu ändern.

Der Verzicht auf den Einsatz von moderner KI-Technologie in Waffensystemen sei mit einem Verzicht auf Elektrizität und Verbrennungsmotoren zu vergleichen, sagt Paul Scharre, ehemaliger Soldat, Berater des US-Verteidigungsministeriums und Autor von „Army of None: Autonomous Weapons and the Future of War“.

KI im Krieg: Autonomie in drei Stufen und herumlungernde Munition

Doch nicht alle autonomen Waffensysteme sind Killerroboter. Die Autonomie von Waffensystemen kann grob in drei Stufen kategorisiert werden:

- Semi-autonome Waffensysteme (Human in the loop)

- Überwachte autonome Waffensysteme (Human on the loop)

- Komplett autonome Waffensysteme (Human out of the loop)

Ein Beispiel für semiautonome Waffensysteme sind „Fire and Forget“-Raketen, die nach Abschuss durch einen Menschen selbstständig ein zuvor bestimmtes Ziel angreifen. Das erlaubt Piloten, mehrere Ziele kurz hintereinander anzugreifen. Die Raketen werden weltweit von Militärs in der Bekämpfung von Luft- und Bodenzielen eingesetzt.

Überwachte autonome Waffensysteme waren traditionell eher defensiv ausgerichtet und kommen überall dort zum Einsatz, wo die menschliche Reaktionszeit mit der Geschwindigkeit des Gefechts nicht mithalten kann.

Das Aegis-System lässt sich an die Anforderungen eines Kapitäns anpassen und wird von Spezialisten bedient. Im Falle eines Angriffs kann eine automatisierte Verteidigung aktiviert werden. | Bild: US Navy

Einmal von einem Menschen aktiviert, greifen sie selbstständig Ziele an – allerdings unter konstanter menschlicher Überwachung. Beispiele sind das auf Marineschiffen eingesetzte Aegis-Kampfsystem, das nach Aktivierung selbständig Raketen, Helikopter und Flugzeuge angreift oder die Raketenabwehrsysteme Patriot und Iron Dome. Über 30 Staaten setzten bereits solche Systeme ein, sagt Scharre.

Doch mit der Entwicklung der neuen Waffengattung der „herumlungernden Munition“ (Loitering Munition) hat sich das geändert: Diese mit Sprengköpfen beladenen Flugdrohnen verfügen über autonome Fähigkeiten und werden von einem Menschen programmiert, bestimmte Ziele anzugreifen. Dieser Angriff kann vom Menschen abgebrochen werden. Sie können Truppen Luftunterstützung geben, ohne Kampfflugzeuge oder -helikopter in Gefahr zu bringen.

Solche Drohnen verwischen die Grenze zwischen überwachten und komplett autonomen Waffensystemen und sind seit mindestens einer Dekade im Einsatz. Zu den verbreiteten Systemen gehören etwa die israelische Harop, die amerikanische Switchblade, die russische Lancet oder die iranische Shahed. Ihre Wirkung im Bergkarabachkonflikt und im Ukrainekrieg veranlasst manche Militärexperten, den durch moderne Technologien möglichen Grad an Autonomie als Teil der Abschreckung zu sehen.

So sieht etwa der ehemalige taiwanesische Generalstabschef, ehemalige Vizeminister für nationale Verteidigung und Befehlshaber der taiwanesischen Marine, Admiral Lee Hsi-ming, herumlungernde Munition als elementar für die militärische Fähigkeit Taiwans, einen möglichen chinesischen Eroberungskrieg zu verhindern.

Der Stand bei autonomen Kriegsmaschinen

Komplett autonome Waffensysteme betreibt offiziell bisher kein Militär. Diese komplett autonome Kriegsmaschinerie ist (noch) nur eine Dystopie der KI-gestützten Kriegsführung.

Dass entsprechende Kriegsgeräte noch nicht eingesetzt werden, hat technisch betrachtet vorwiegend einen Grund: Die benötigte KI-Technologie existiert noch nicht. Der Machine-Learning-Boom der letzten Dekade hat zwar unzählige Fortschritte in der KI-Forschung hervorgebracht, aber aktuelle KI-Systeme sind nicht für den professionellen militärischen Einsatz geeignet.

Sie versprechen in der Theorie zwar Präzision, Verlässlichkeit und eine hohe Reaktionsgeschwindigkeit. Doch in der Praxis scheitern sie noch immer an der Komplexität der echten Welt. Die KI-Systeme verstehen keinen Kontext, kommen nicht mit sich ändernden Umständen zurecht, sind anfällig für Angriffe und schon gar nicht dafür geeignet, ethische Entscheidungen über Leben und Tod zu treffen. Aus den gleichen Gründen fährt trotz massiver Investitionen und großer Versprechen auch 2022 noch kein autonomes Auto souverän über unsere Straßen.

Zudem haben sich die NATO und die USA zwar für die Entwicklung und den Einsatz von autonomen Systemen ausgesprochen, wollen aber über überwachte autonome Waffensysteme nicht hinaus gehen – Menschen sollen die Kontrolle über die Systeme behalten. Doch auch dafür benötigt es zuverlässige KI-Systeme. Die Forschungsabteilung des US-Militärs DARPA fördert entsprechende Entwicklungen mit Milliarden US-Dollar.

Doch was genau ist Kontrolle? Wo die Grenze genau verläuft, ist nicht immer klar – reicht es, dass ein Mensch ein Waffensystem startet, das dann selbstständig tötet. Muss er es auch wieder ausschalten können? Was ist mit Situationen, in denen menschliche Entscheidungsgeschwindigkeiten nicht mehr ausreichen?

Mensch-Maschine-Kooperation in der Luft

Aktuell liegt der Fokus von Militär und Rüstungskonzernen primär in der Fusion verschiedener Sensordaten und der Entwicklung von Systemen, die mit Menschen kooperieren. Der Fokus des US-Militärs läge auf der kognitiven Assistenz in der gemeinsamen Kriegsführung, sagt JAIC-Chef Nan Mulchandani.

Manche dieser Systeme sollen eigenständig fliegen, fahren, tauchen, Informationen sammeln, festgelegte Ziele selbstständig angreifen oder Nachschub liefern. Aber ihre Aufgaben, Ziele und Freigaben bekommen sie immer von einem Menschen.

Die US Air Force testete etwa im Rahmen des „Skyborg-Programms Varianten der XQ-58A-Drohne von Kratos. Die Stealth-Drohnen sollen günstig sein und an der Seite eines menschlichen Piloten fliegen, von ihm Befehle entgegennehmen, aufklären, Ziele bekämpfen und ihn verteidigen. Das Programm ist seit 2021 als geheim eingestuft, doch bis zu ein Dutzend der Drohnen sollen im Frühjahr 2023 einsatzbereit sind. Die US Navy entwickelt derweil autonome Tankflugzeuge basierend auf der MQ-25A-Stingray-Drohne.

Auch Boeing hat eine Loyal-Wingman-Drohne entwickelt und verkauft sie an die australische Luftwaffe (RUAF). Die russische Luftwaffe setzt dagegen auf die größere S-70-Okhotnik-Drohne, die chinesische Luftwaffe auf die FH-97A.

Die Drohnen sollen im Kampfeinsatz meist zentral von einem Next-Generation-Fighter (NGF) von einem menschlichen Pilot gesteuert werden. Der wiederum wird an Board unterstützt von einem KI-Co-Piloten. Das reduziert Latenzen in der Kommunikation.

In Europa ist die Entwicklung einer autonome Begleiterdrohne als Remote Carrier (RC) im Next Generation Weapon System (NGWS) Programm des NGF-Programms von Frankreich, Deutschland und Spanien geplant. Ein zweites Programm in Europa läuft unter dem Namen Tempest und wird von England, Italien und Japan finanziert.

KI-Drohnen im Wasser und an Land

Auch im Wasser sollen Drohnen Menschen unterstützen: Beispiele sind semiautonome Schiffen wie der US-Navy-Zerstörer Sea Hunter, das Orca-U-Boot von Boeing oder die simplen Drohnenboote, die in der Ukraine die russischen Marine angreifen.

Für den Einsatz am Boden entwickeln Rüstungsunternehmen verschiedene Waffen wie die Kampfdrohne Ripsaw M5, die Panzer der US Army begleiten soll, oder den russischen Uran-9-Panzer, der bereits – wohl wenig effektiv – in Syrien eingesetzt wurde. Die US-Infanterie operiert mit winzigen Aufklärungsdrohnen mit Wärmebildkameras, die US Air Force testet den teilautonomen Roboterhund von Ghost Robotics.

Die US-Armee setzt auf die winzige Black-Hornet-Drohne für eine schnelle Aufklärung durch die Infanterie. | Bild: DoD

Im Ukrainekrieg zeigt sich zudem, welche zentrale Rolle die Aufklärung per Drohnen und Kommunikation zwischen Drohnen-Operator, Artillerie und Infanterie spielt. Die so gewonnene Präzision erlaubte der Ukraine, den russischen Vorstoß effektiv aufzuhalten.

Die tieffliegende und günstige Aufklärung erfolgt noch über menschliche Augen, doch die Ukraine trainiert laut eines ukrainischen Drohnensoldats neuronale Netze mit den vorhandenen Aufnahmen. Die Drohnen sollen so russische Soldaten und Fahrzeuge automatisch erkennen und den OODA-Loop (Observe, Orient, Decide, Act) drastisch beschleunigen.

Künstliche Intelligenz im Cyberraum und zukünftigen Konflikten

Abseits des realen Kriegsgeschehens wird KI vermehrt im Cyberraum eingesetzt. Dort kann sie helfen, Malware aufzuspüren oder Muster bei Cyberangriffen auf kritische Infrastrukturen erkennen.

Ende 2022 testete die NATO KI für die Cyberverteidigung: Sechs Teams hatten die Aufgabe, Computersysteme und Stromnetze in einer fiktiven Militärbasis einzurichten und während eines simulierten Cyberangriffs am Laufen zu halten.

Drei der Teams erhielten Zugang zu einem Prototyp eines Autonomous Intelligence Cyberdefense Agent (AICA), der vom Argonne National Laboratory des US-Energieministeriums entwickelt wurde. Der Test zeigte, dass AICA half, Beziehungen zwischen Angriffsmustern, Netzwerkverkehr und Zielsystemen besser zu verstehen und zu schützen, so Cybersicherheits-Experte Benjamin Blakely, der das Experiment mit leitete.

Ob Cybersicherheit, kognitive Assistenz, Sensorfusion, herumlungernde Munition oder bewaffnete Roboterhunde: Künstliche Intelligenz verändert bereits jetzt das Schlachtfeld. Die Effekte werden in kommenden Jahren noch zunehmen, wenn Fortschritte in der Robotik, der Entwicklung von Weltmodellen oder KI-gestützte Materialwissenschaften und Fertigungstechniken neue Waffensysteme ermöglichen.

Auch LAWS werden wohl ein Teil dieser Zukunft sein, zumindest deutet darauf ein Regulierungsvorschlag mit dem Titel „Principles and Good Practices on Emerging Technologies in the Area of Lethal Autonomous Weapons Systems“ hin. Er wurde im März 2022 von Australien, Kanada, Japan, der Republik Korea, dem Vereinigten Königreich und den Vereinigten Staaten der UN vorgelegt.

Zusammenfassung

- Künstliche Intelligenz kann im Militär in vier Bereichen eingesetzt werden: Logistik, Aufklärung, Cyberraum und Kriegsführung.

- Zahlreiche Staaten entwickeln KI-Systeme für das Militär oder setzen sie aktiv ein. Jüngst im Ukrainekrieg.

- Autonome Waffen gelten als die dritte Revolution in der Kriegsführung nach der Erfindung des Schießpulvers und der Atombombe.

- Ihr Einsatz ist teils durch den aktuellen Stand der Technik, teils durch ethische Richtlinien eingeschränkt, könnte in Zukunft jedoch zunehmen.

CHAT-GPT GUIDE: 7 PROMT-STRATEGIEN FÜR BESSERE ERGEBNISSE

Wie spreche ich am besten mit ChatGPT? Bei der Kommunikation mit der KI gibt es praktisch keine richtigen oder falschen Eingaben. Es gibt jedoch einige Richtlinien, die dabei helfen, die richtigen Prompts zu formulieren.

Das dialogorientierte KI-Modell ChatGPT ist seit Ende November 2022 verfügbar und Nutzer:innen loten seitdem die Grenzen und Möglichkeiten des Chatbots aus. OpenAI nimmt aber auch laufend Anpassungen vor.

Um das gewünschte Ergebnis zu erzielen, werden möglichst konkrete Textbefehle benötigt. Neben der einfachen Textgenerierung für Blogbeiträge oder Social Media Posts beherrscht ChatGPT weitaus vielfältigere, teils kuriose Anwendungsfälle.

Mittlerweile kursieren zahlreiche Tipps und Vorschläge für ChatGPT-Befehle im Netz, von denen wir hier einige ausgewählte und überprüfte vorstellen wollen, die wir für besonders hilfreich halten.

Zuvor noch einige grundlegende Tipps:

- ChatGPT wurde zwar auch mit deutschen Daten trainiert, der Anteil englischer Texte im Trainingsmaterial ist jedoch deutlich höher. Es kann helfen, die Anfragen auf Englisch durchzuführen und die Ausgabe erst anschließend mit Tools wie DeepL zu übersetzen.

- ChatGPT verarbeitet bis zu 4.096 Tokens in einer Eingabe, jeder Buchstabe darüber wird ohne Meldung ignoriert. Ein Token entspricht ungefähr einem Wort, dies hängt immer vom Anwendungsfall ab.

- Die Generierung von Antworten kann mit dem Stop-Knopf über dem Eingabefeld abgebrochen werden.

- Wenn im Chatverlauf zu viel Wissen ausgetauscht wurde, kann es hilfreich sein, einen neuen Chat zu beginnen, um die nachfolgenden Antworten nicht zu verfälschen.

- Obwohl sich die Kommunikation mit ChatGPT manchmal fast menschlich anfühlt, sind Höflichkeiten wie „bitte“ und „danke“ überflüssig. ChatGPT braucht keine eloquenten, sondern klar formulierte Anweisungen.

Rolle festlegen

Ob Linux-Terminal, Philosoph, Teeverkoster oder Bibelübersetzer – ChatGPT kann all diese Rollen einnehmen und noch viel mehr. Dazu braucht die KI nur einen Schubs in die richtige Richtung.

Praktischerweise hat der Entwickler Fatih Kadir Akın eine ganze Reihe solcher Situationsbeschreibungen inklusive ausformulierter Prompts auf seiner Webseite zusammengestellt.

Die Prompts sind immer gleich aufgebaut: Zunächst erhält ChatGPT den Prompt, in welche Rolle die KI im Folgenden schlüpfen soll. Anschließend steht im Prompt, welche Informationen der oder die Nutzer:in bereitstellt, danach, was genau die KI daraus machen soll, inklusive grober Richtungsvorschläge. Schließlich formuliert der Entwickler die erste konkrete Anweisung in Anführungszeichen.

Beispiel Reiseführer

Ich möchte, dass du als Reiseführer fungierst. Ich schreibe dir meinen Standort und du schlägst mir einen Ort vor, den ich in der Nähe meines Standorts besuchen kann. In manchen Fällen werde ich dir auch die Art der Orte nennen, die ich besuchen werde. Du wirst mir auch Orte ähnlicher Art vorschlagen, die sich in der Nähe meines ersten Standortes befinden. Mein erster Befehl lautet: „Ich bin in Istanbul/Beyoğlu und möchte nur Museen besuchen.“

Ansprache und Kanal definieren

Um mühsames Umformulieren, entweder von Hand oder durch einen weiteren Prompt, zu vermeiden, ist es ratsam, ChatGPT so viele Informationen wie möglich zu geben. Dabei sollte man der KI klar mitteilen, wie sie die Leser:innen ansprechen soll und für welchen Kanal der Text gedacht ist. ChatGPT beherrscht auch das Gendern, solange man zu Beginn die gewünschte Form definiert.

Denn es macht für ChatGPT einen großen Unterschied, ob der Text später z.B. in einem Blogbeitrag, auf einer Shopseite, als LinkedIn-Post, Tweet, TikTok oder YouTube-Skript ausgegeben werden soll.

Beispiel TikTok

Ich brauche ein Skript für ein TikTok über die Chancen und Risiken von ChatGPT. Verwende dazu möglichst kurze Sätze. Sprich den Zuschauer mit du an. Verwende möglichst geschlechtsneutrale Sprache.

Eingaben verketten (Chained Prompting)

Ein Stichwort, das Expert:innen im Zusammenhang mit besseren ChatGPT-Eingaben häufig erwähnen, ist das sogenannte „Chained Prompting“. Dabei werden komplexe Aufgaben in mehrere Zwischenschritte unterteilt, in der Hoffnung, dass die KI ein konkreteres, individuell angepasstes und damit insgesamt besseres Ergebnis liefert. Das funktioniert sowohl in einer einzigen langen Eingabeaufforderung als auch in mehreren hintereinander.

Die wohl einfachste Form des Chained Promptings besteht darin, zunächst nach der Struktur eines Artikels zu fragen. Danach kann man ChatGPT anweisen, die entsprechenden Stichpunkte zu formulieren. Diese Methode spart auch Zeit: Wenn ihr schon bei der Gliederung merkt, dass die KI einen falschen Weg einschlägt, könnt ihr noch die nötigen Anpassungen vornehmen, bevor der komplette Text erstellt wird.

Beispiel Chained Prompting

Schreibe einen Artikel über ChatGPT. Gib mir zuerst die Gliederung, die aus einer Headline, einem Teaser und mehreren Zwischenüberschriften besteht.

[Output]

Jetzt schreibe fünf Kernbotschaften zu jeder Zwischenüberschrift.

[Output]

Ergänze fünf Keywords zu den Kernbotschaften bei jeder Zwischenüberschrift.

[Output]

Und so weiter …

Ausgabe abändern

Auch wenn ihr alle vorherigen Ratschläge befolgt habt, kann es vorkommen, dass ihr denselben Inhalt für verschiedene Kanäle aufbereiten wollt, etwa Linkedin, Twitter oder Facebook. Der Text soll dabei für die Tonalität und die Formatierung des Zielkanals angepasst werden.

Auch diese Aufgabe übernimmt ChatGPT mit dem richtigen Befehl. Wichtige Argumente können wieder die Erwähnung des Kanals sein, aber auch Beschreibungen des Formats.

Beispiel Twitter

Formuliere den generierten Text in mehreren Tweets. Beachte die maximale Länge von 280 Zeichen pro Tweet. Verwende kurze Sätze und strecke sie nicht über mehrere Tweets. Beginne die Tweets mit einer einheitlichen Nummerierung.

Beispiel Linkedin

Formuliere den generierten Text als Linkedin-Posting. Beachte die maximale Länge von 3000 Zeichen. Strukturiere die Kernaussagen des Textes als übersichtliche Liste. Steige mit einem spannenden Teaser-Satz ein und beende das Posting mit einer Handlungsaufforderung für Kommentare, Shares oder Likes.

Ausgabe formatieren

In der Regel antwortet ChatGPT wortreich im Fließtext. Tatsächlich beherrscht das KI-Tool aber auch die Formatierung in der Auszeichnungssprache Markdown, z.B. für Überschriften, fetten oder kursiven Text, geordnete (nummerierte) oder ungeordnete Listen und sogar Tabellen.

Diese Möglichkeiten lassen sich gut für die eigene Textgenerierung nutzen. Allerdings kommt ChatGPT in den meisten Fällen nicht selbst auf die Idee und benötigt daher einen entsprechenden Hinweis auf die Formatierung. Im Sinne des Chained Prompting kann man die Formatierung natürlich auch nachträglich vornehmen.

Beispiel Markdown

Ich möchte einen Blog-Artikel über ChatGPT geschrieben haben. Schreibe eine Überschrift, einen Teaser, einen Untertitel und einen Absatz. Formatiere alles in Markdown.

Prompt-Anleitung generieren

Justin Fineberg hat einen interessanten Ansatz für die Kommunikation mit ChatGPT gefunden. Ähnlich wie beim ersten Tipp weiter oben wird die KI angewiesen, eine bestimmte Rolle einzunehmen.

Diesmal übernimmt ChatGPT jedoch die mühsame Aufgabe, die Struktur für weitere Prompts zu generieren. Der Chatbot stellt sich also selbst genau die Fragen, die in den nächsten Prompts beantwortet werden müssen. Wenn ChatGPT die Fragen in Form einer nummerierten Liste schreibt, könnt ihr mit den Zahlen direkt darauf verweisen.

Beispiel Prompt-Anleitung

Du bist ein Roboter zur Erstellung von Prompts. Du musst Informationen über die Ziele des Benutzers, Beispiele für die bevorzugte Ausgabe und alle anderen relevanten Kontextinformationen sammeln.

Der Prompt sollte alle notwendigen Informationen enthalten, die dir zur Verfügung gestellt wurden. Stelle dem Benutzer weitere Fragen, bis du sicher bist, dass du einen optimalen Prompt erstellen kannst.

Deine Antwort sollte klar formatiert und für ChatGPT-Interaktionen optimiert sein. Beginne damit, den Benutzer nach den Zielen, dem gewünschten Ergebnis und allen zusätzlichen Informationen zu fragen, die du eventuell benötigen.

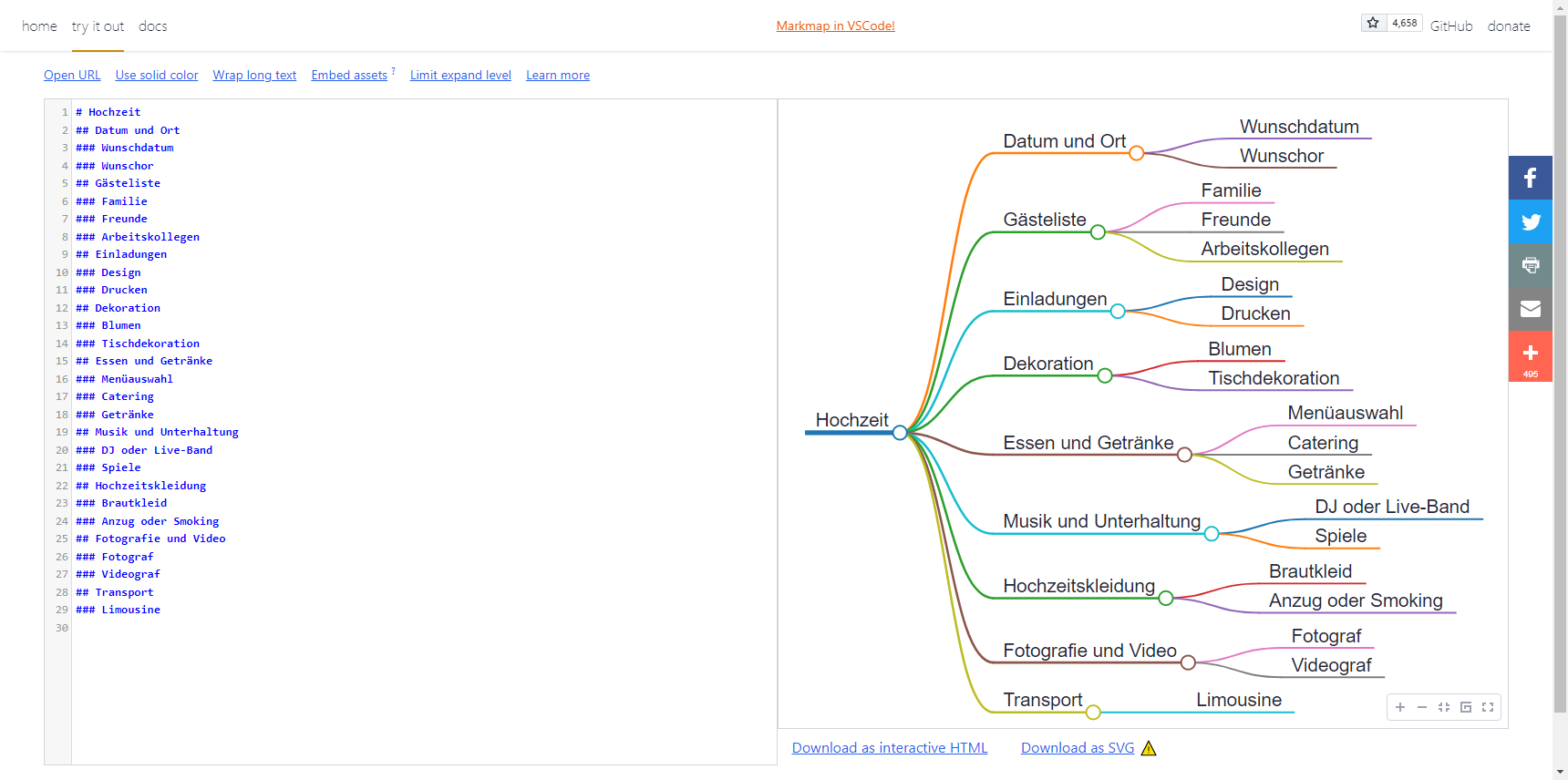

Mindmaps visualisieren

Ein großer Vorteil von ChatGPT gegenüber GPT-3 ist, dass die Benutzeroberfläche von Haus aus die Ausgabe im Markdown-Format unterstützt. Dies ermöglicht eine schnelle visuelle Unterscheidung zwischen verschiedenen Hierarchien von Überschriften, was bei der visuellen Strukturierung eines Textes sehr hilfreich ist.

Über die kostenlose Webseite markmap.js.org können Markdown-Texte in Mindmaps verwandelt werden, wie Alexander Leirvåg auf Twitter schreibt.

Basierend auf der Hierarchie der jeweiligen Überschrift stellt die Webseite den eingegebenen Text als Mindmap dar und unterstützt sogar weitere Formatierungen der einzelnen Einträge, etwa für Code oder Formeln. Die Grafik kann anschließend entweder als interaktive Webseite in HTML oder als Vektorgrafik im SVG-Format heruntergeladen werden.

Wichtig: Damit ihr Text, der als Markup formatiert ist, korrekt kopieren könnt, müsst ihr ChatGPT daran hindern, ihn als Markup anzuzeigen. Das geht, indem ihr der KI sagt, dass sie die Ausgabe von „ einschließen soll, was Markdown-Formatierung für Code bedeutet.

Beispiel Mindmap

Markmap syntax In markmap, each layer becomes a separate branch by #. Example: mindmapping a birthday party. # Birthday ## Activities ### Fishing Candy ### Trampoline ## Food ### Cake ### Hotdogs ... Use Markdown to create a mindmap for planning a wedding. Enclose the output in ` and `.

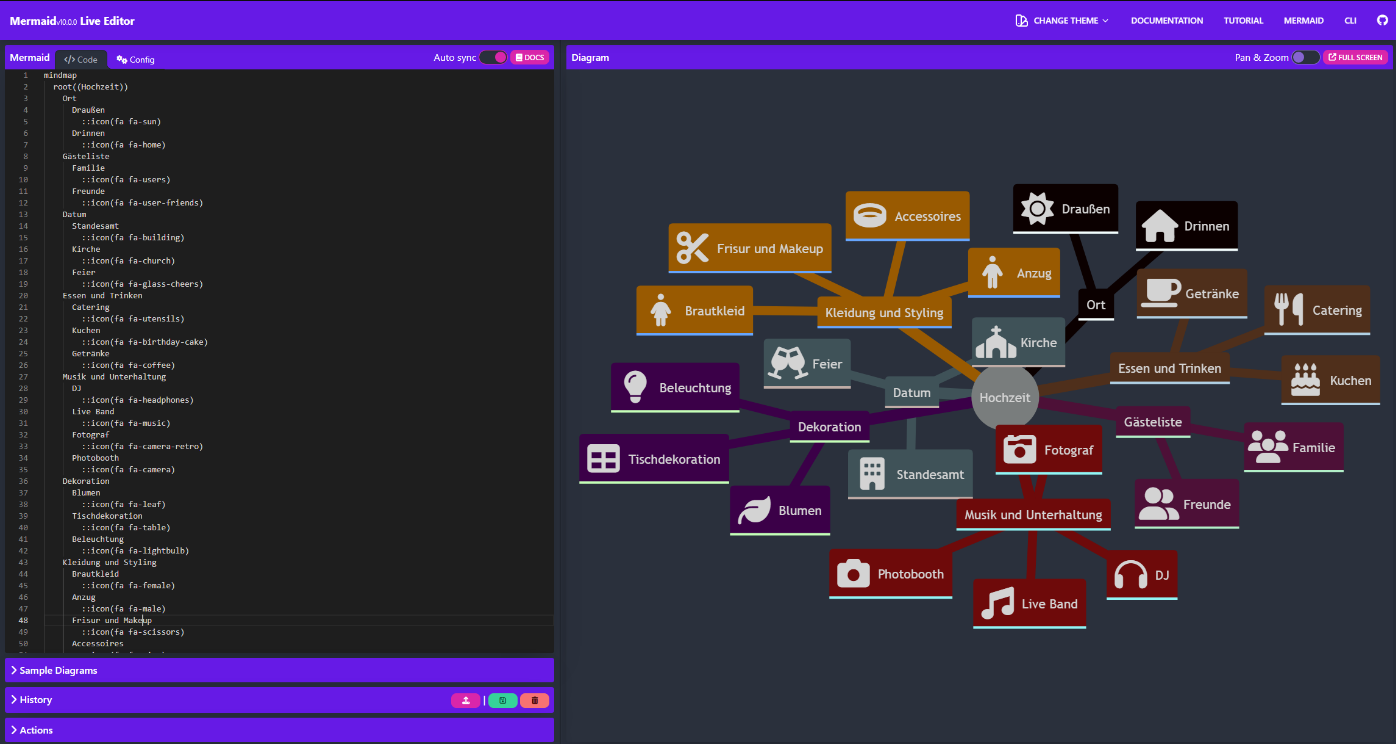

Wer es etwas komplexer mag, sollte sich mit der Syntax von Mermaid vertraut machen. Dazu kann man ChatGPT einfach ein Beispiel geben, an dem es sich orientieren soll. Mermaid-Diagramme sind optisch ansprechender als einfache Mindmaps und können sogar mit Icons versehen werden, die ChatGPT selbst auswählt.

Mermaid kann keine Bindestriche in Knotenbeschriftungen (z.B. „Make-up“) verarbeiten. Diese müssen aus der ChatGPT-Ausgabe entfernt werden. Die Ausgabe von ChatGPT könnt ihr in mermaid.live einfügen und so in eine Grafik umwandeln.

Beispiel Mermaid

Erstelle den Code für eine Mindmap in Mermaid für die Planung einer Hochzeit und benutze dabei auch passende Icons. Achte auf die richtige Anzahl an Leerzeichen für die Hierarchie der Ebenen. Schließe die Ausgabe in ` und ` ein.

Hier ist ein Beispiel für Code für Mermaid:

mindmap

root((Wedding))

Venue

Outdoor

::icon(fa fa-sun)

Indoor

::icon(fa fa-home)

Guest List

Family

::icon(fa fa-users)

Friends

::icon(fa fa-user-friends)

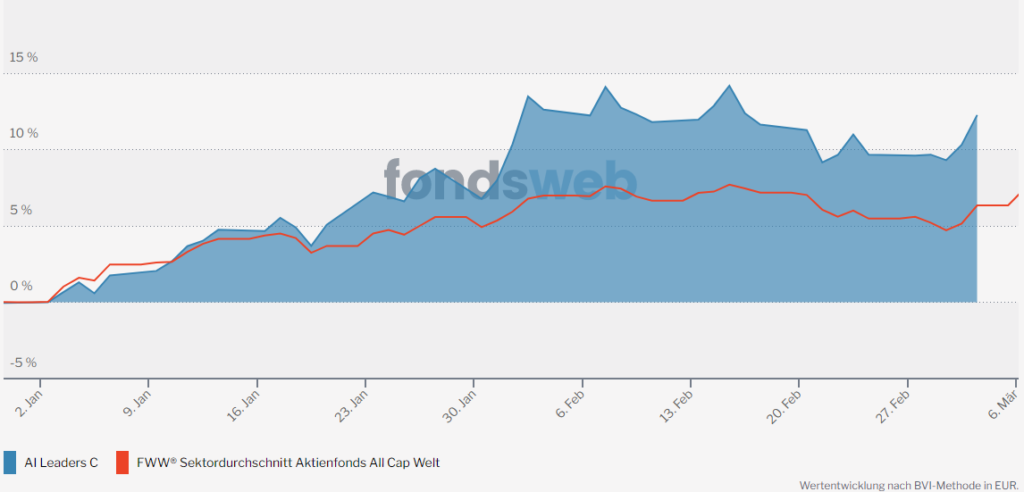

AI LEADERS – DER FONDS

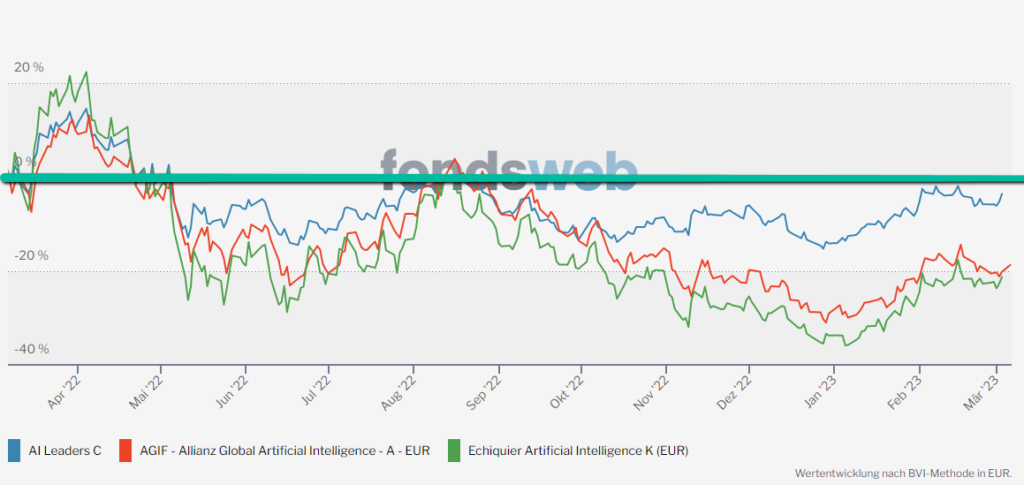

Nach dem guten Start ins neue Jahr verlief der Februar an den Börsen etwas holpriger. Der AI Leaders konnte aber auch im Februar um 1,56% zulegen und liegt aktuell (Stand: 6.3.2023) mit 12,30 % seit Jahresbeginn im Plus. Die ursprünglich hohe Volatilität konnten wir inzwischen durch den Einsatz von TOPAS auf 17,03% reduzieren.

Der Februar zeigte sich insgesamt sicherlich herausfordernd. Hintergrund sind nach wie vor die Zinsspekulationen, insbesondere in den USA. Über den abgelaufenen Monat hinweg kristallisierte sich unter den Marktteilnehmern immer wieder die Befürchtung heraus, dass die Zinsen doch noch weiter steigen könnten, als das bislang angenommen wurden. Das sorgte für reichlich Schwankungen an den US-Börsen.

Bei dieser Geräuschkulisse müssen wir uns jedoch vor Augen führen, dass die wirklich bestimmenden Faktoren aufseiten unserer Unternehmen unverändert hervorragend sind. Fortgesetzt haben unserer Depotunternehmen gute Resultate für das vergangene Jahr und Ausblicke auf das laufende Jahr gegeben.

Entwicklung seit Jahresbeginn

Im Vergleich zur Konkurrenz von Allianz und Echiquier konnten wir uns weiterhin positiv abheben. Während die Konkurrenz auf Sicht der letzten 12 Monate mit rund -20% noch deutlich im Minus verweilt, fehlt dem AI Leaders nur noch einige wenige Prozentpunkte.

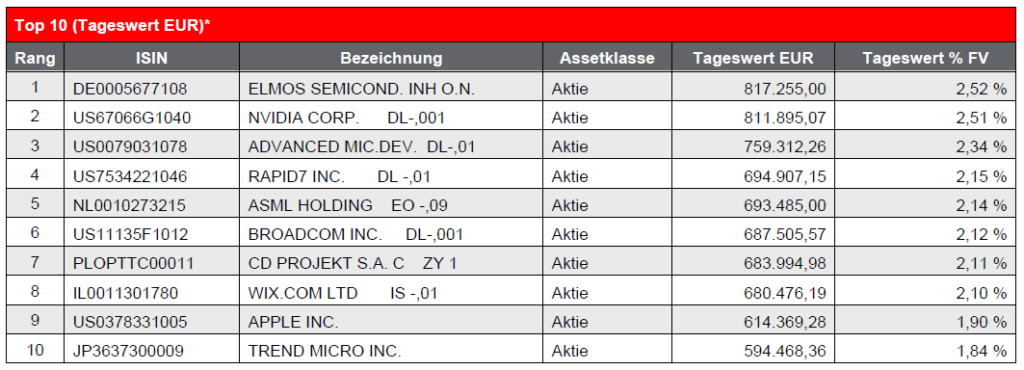

Der AI Leaders ist aktuell in 131 Aktien investiert. Bei den größten Positionen haben sich die letzten Wochen keine Änderungen ergeben.

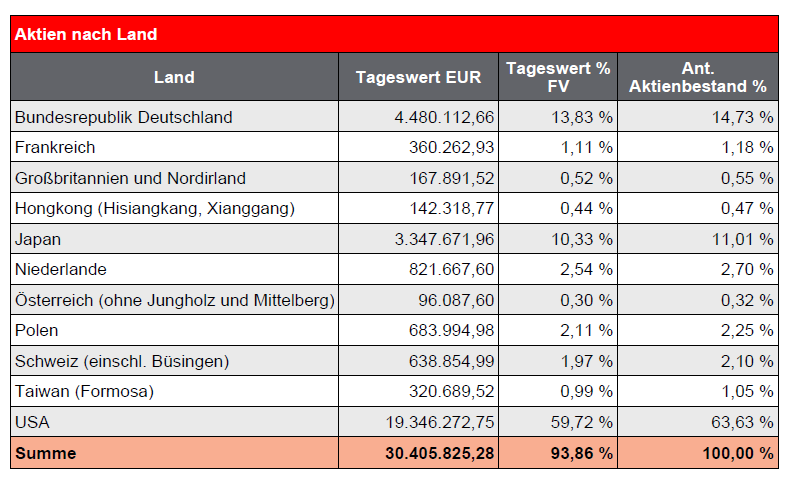

Die gilt auch für die Länderverteilung:

Die weitere Entwicklung des AI Leaders sehen wir äußerst positiv, da die Depotunternehmen mit durchschnittlich über 20% wachsen und die Überbewertungen vollumfänglich im Frühjahr 2022 abgebaut wurden.

Für weitere Fragen stehen wir Ihnen wie immer gerne zur Verfügung.

Für weitere Fragen stehe wir Ihnen wie immer gerne zur Verfügung.

Herzliche Grüße aus Stuttgart

Tilmann Speck

Christian Hintz

Gerd Schäfer